2023.06.07

2023.06.07 9568

9568

5月30日,由云安全联盟大中华区主办,OPPO、深信服、新华三、虎符网络、齐安科技、熠数信息承办的“CSA研讨会——ChatGPT安全”在线上召开,并在会上发布了CSA白皮书《ChatGPT的安全影响》。

本次会议由CSA大中华区数据安全工作组联席组长&OPPO终端安全总经理王安宇、中国电信研究院安全技术研究所技术总监蔡逆水、睿企科技董事长兼首席科学家于伟三位专家从各自的专业视角,解读《ChatGPT的安全影响》白皮书,探讨安全GPT大模型对关键基础设施运营商的影响及应对策略,以及安全可靠的垂直领域大模型训练与应用。此外一场以“ChatGPT及其安全影响”为主题的圆桌讨论也在会议中进行,由CSA大中华区数据安全工作组联席主席组长王安宇主持,邀请了虎符网络创始人兼CEO王伟、熠数信息总经理陈杨轲、齐安科技副总经理张宙、新华三安全公司云与大数据安全总监刘忠良、深信服科技安全业务运营总监訾然共同参与,这场研讨会为参与观众提供了一个深入理解和讨论AI安全影响的宝贵机会。

深度剖析-《ChatGPT的安全影响》

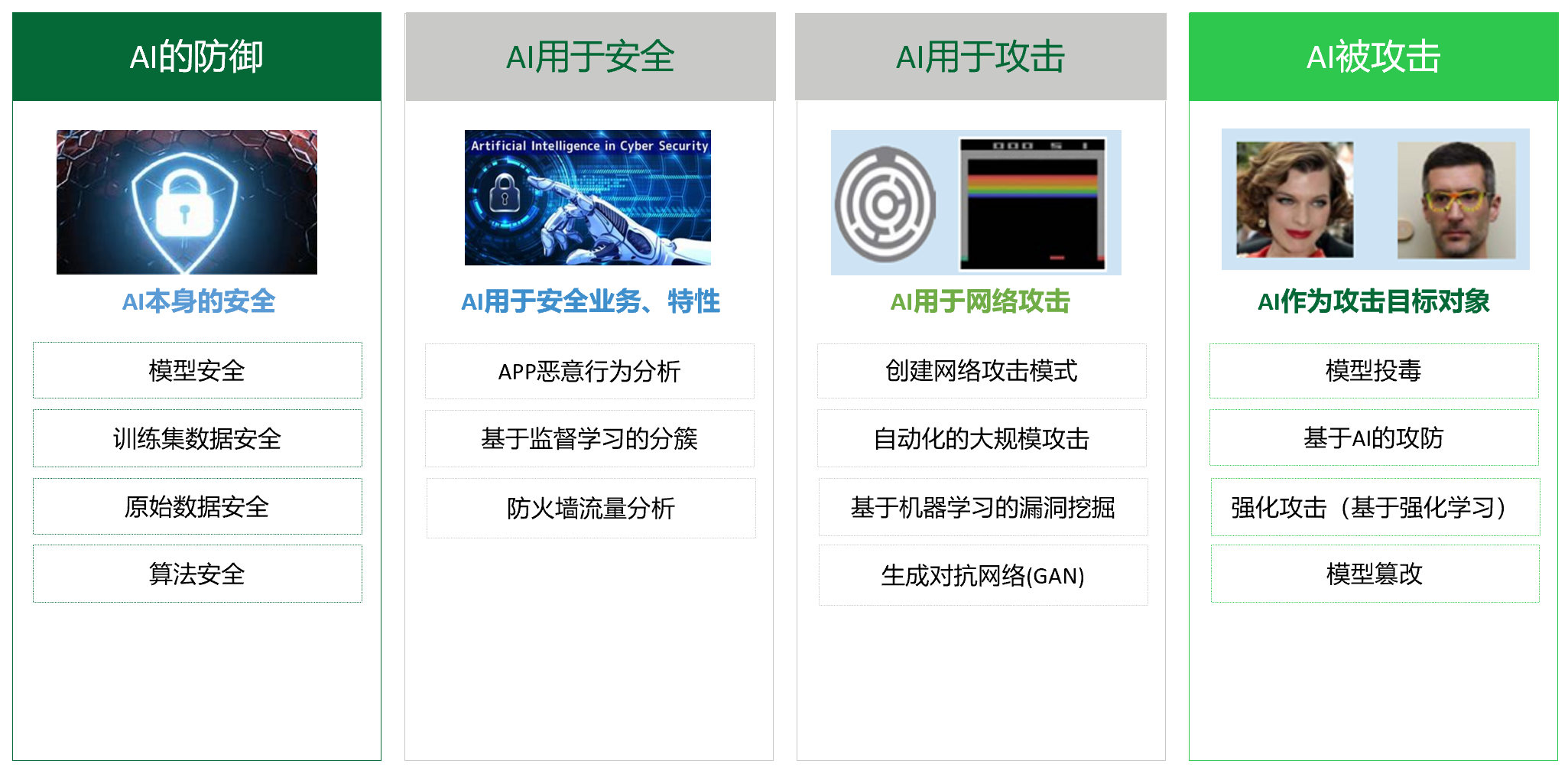

王安宇在会上中谈到ChatGPT作为AI的一种用例或者说场景,其和网络安全领域有如下四个维度的交互:

第一个维度“AI用于攻击”,分析了攻击者(恶意行为者)可以如何利用ChatGPT增强其“武器库”。特别是,针对网络攻击链的各个环节,特别是“侦查”和“漏洞利用”两个环节,ChatGPT都可以起到非常大的作用。

第二个维度“AI用于安全(防御)”,是指防御者也可以将AI作为防御手段,从广度和深度两个维度,提升防御的质量和效率。

第三个维度“AI的防御”,是指AI模型本身的安全。主要是指提供方需要从正向设计AI模型的安全性。ChatGPT的开发者OpenAI并未公开发布论文或者白皮书,详述ChatGPT的防御机制,特别是模型安全、算法安全等维度。但是,作为互联网服务,其互联网基础设施的安全问题,例如连接和会话安全、API安全、用户的身份认证和传输加密等,均不容忽视。

第四个维度“AI被攻击”,是指AI作为被攻击的目标对象。这个维度和“AI的防御”类似,只是从攻击和防御的不同视角。由于ChatGPT可以通过自然语言处理技术理解用户的输入,黑客可以通过发送恶意提示信息来攻击ChatGPT,从而窃取用户的敏感信息,这种攻击方式一般被称为“提示注入攻击”。因此,ChatGPT的开发者需要采取一系列的安全措施来保护ChatGPT的安全。

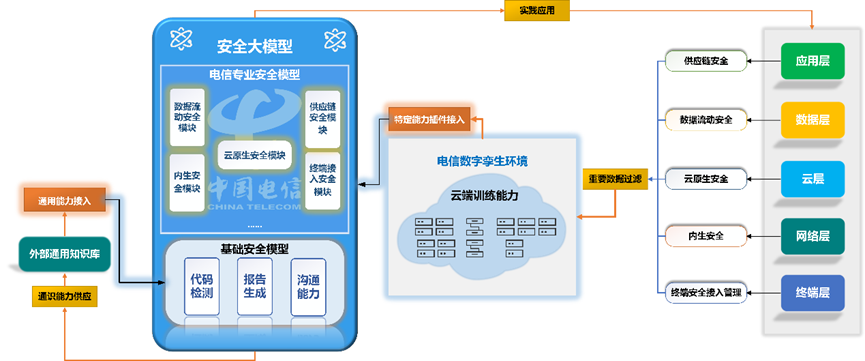

电信运营商安全GPT大模型建设的核心能力要求和主要策略

蔡逆水主要讨论了GPT对电信运营商的安全影响,研究了安全GPT助力电信运营商安全的两个主要方面,提升态势感知能力和安全运营效率,推荐了“1+1+N”的安全GPT大模型建设模式及主要核心功能,最后探讨了电信运营商的应对策略:

- 安全GPT模型功能分为基础安全模型和专业安全模型及插件。安全GPT模型是在基础安全模型的基础上,增加特定领域的安全功能,并提供插件化的设计,以满足不同用户的需求。

- 采取分阶段推进,先易后难的策略。第一阶段完成通用安全知识基础安全模型能力。第二阶段完成偏用户服务的专业安全模型能力。

- 安全GPT大模型将安全考虑融入到整个流程中,采用DevSecOps策略,保障安全GPT大模型产品的内生安全性。

安全可靠的垂直领域大模型

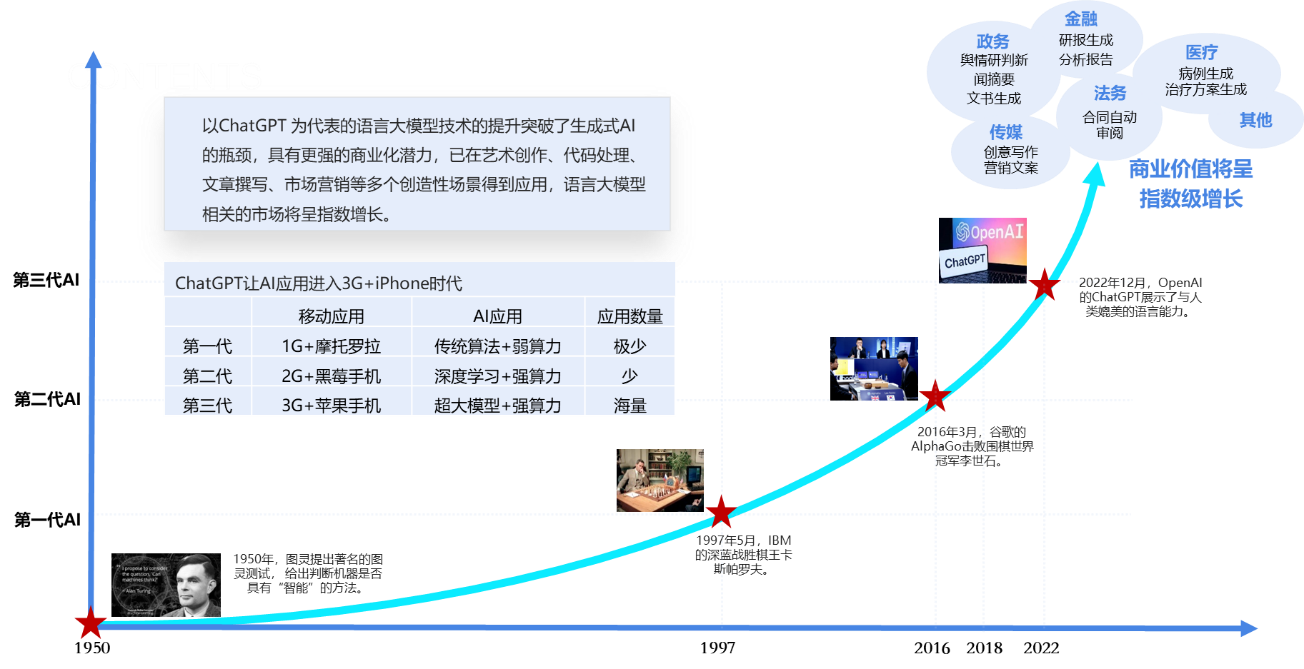

于伟认为:“随着经济的发展,数字经济占GDP的比重越来越高,中国逐步进入数智经济时代,利用AI技术提升生产力为大势所趋。以ChatGPT为代表的语言大模型技术的提升突破了人工智能的技术瓶颈,让人工智能进入大规模应用阶段,人工智能市场规模将呈指数增长。同时,伴随大模型技术的广泛应用,相应的安全风险也需要同步考虑和预防。我们从个人隐私泄露与侵犯、知识产权侵犯、训练数据投毒、恶意行为防范等维度进行了分析,总结了大模型安全的需要考虑的几个点,包括:加强系统本身的安全防护,防止信息泄露和黑客攻击;建立训练与反馈数据质监机制,在模型迭代过程中防止数据投毒等行为;建立完善的模型行为权限管理机制,防止模型本身的不可控甚至恶意行为。”

此外,对于大模型训练,他提到基于专业知识和数据训练安全可靠的垂直领域大模型势在必行,模型训练机制需要注意一下三点:

- 训练数据:需要高质量专业训练数据,需要有完善的机制剔除掉问题数据、错误数据等。

- 价值对齐:需要通过训练数据和训练过程完成价值对齐,确保模型符合预期。

- 基础模型:如果垂直领域大模型是基于基础通用大模型进行训练的,需要做好基础模型的检查,避免因为基础模型本身带来的问题。

而在大模型训练的时候要采取必要的安全防护,建立训练与反馈数据质监机制,在模型迭代过程中防止数据投毒等行为。

共话ChatGPT未来,畅谈行业新发展

在研讨会的最后,王安宇主持圆桌论坛,通过连线王伟、陈杨轲、张宙、刘忠良和訾然,从ChatGPT的解决方案、各行业影响、对企业带来的优势与风险等多个角度探讨了ChatGPT安全的未来发展趋势。

在圆桌讨论中,各位专家从各自领域的视角深入探讨了ChatGPT的多元影响。尽管这项技术在网络安全、金融科技、制造业等领域有着广泛的应用潜力和价值,但同时也存在诸多新的挑战和风险。然而,无论优势还是风险,都指向了一个共同的结论:大语言模型,如ChatGPT,正成为我们未来日常生活和工作的重要组成部分,我们需要更深入地理解和掌握这一技术,以充分利用其优势,应对其带来的挑战。

登录

登录

雷池WAF

雷池WAF 安恒信息

安恒信息